KI-Musikproduktions-Tools 2026: Reibung in Workflows reduzieren

Ein befreundeter Produzent hat letzten Monat drei Stunden damit verbracht, eine Stimme aus einem Stereo-Mix zu extrahieren.

Er probierte EQ-Schnitzerei und Phasen-Inversions-Tricks, die er über die Jahre auf YouTube aufgeschnappt hatte – hier die Stimme ein paar Dezibel hochgezogen, dort die Drums runtergeregelt.

Am Ende gab er auf, mutete die Original-Spur stumm und baute das komplette Instrumental von Grund auf neu um die gerettete Stimme herum.

Drei Stunden kreative Energie für etwas, das den emotionalen Bogen des Tracks nie verändert hätte.

Je mehr KI-Tools in die Musikproduktion einziehen, desto häufiger werden solche Geschichten, nicht seltener.

Versprochen werden „Instant-Master“, „One-Click-Remixe“ und komplette Songs in 30 Sekunden. Für viele arbeitende Produzenten aber hat mehr Software nicht mehr fertige Musik bedeutet – nur mehr Entscheidungen, mehr Optionen und, ehrlich gesagt, mehr kreative Erschöpfung.

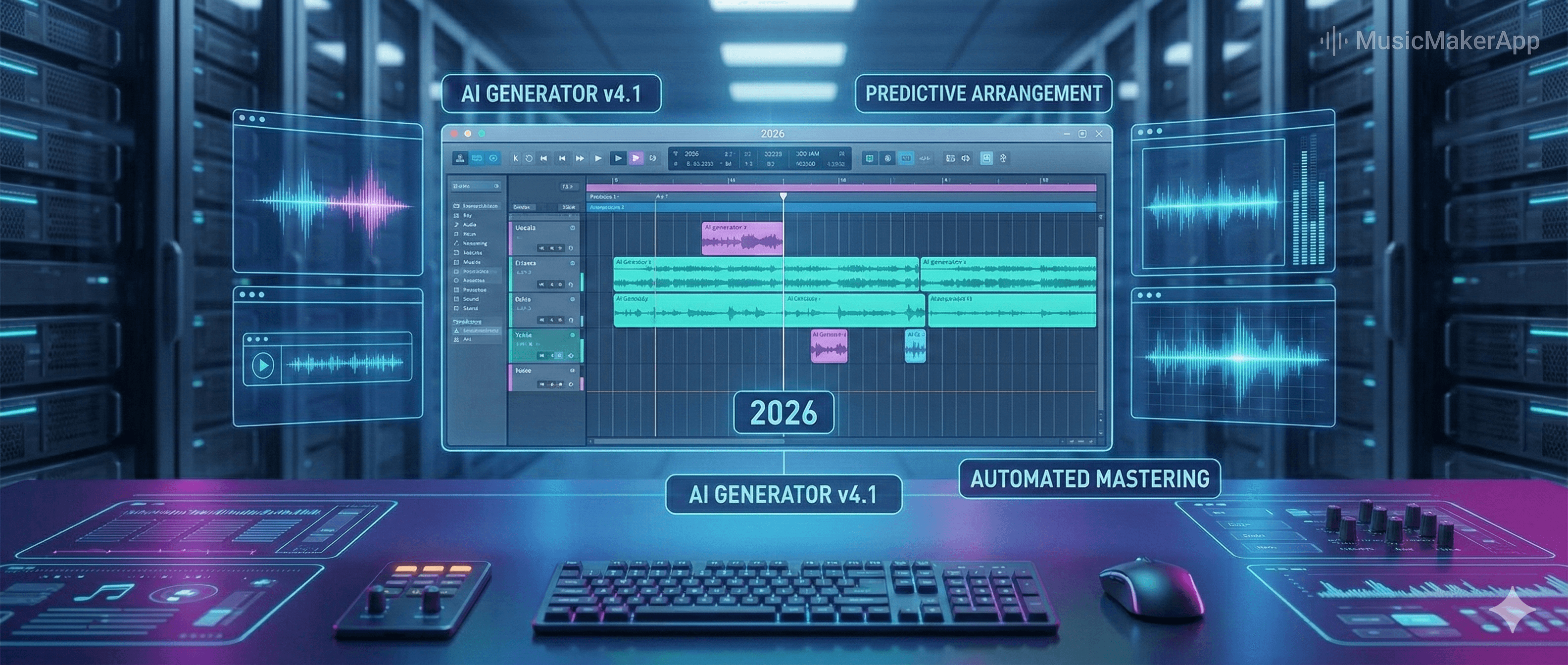

2026 sind die interessantesten KI-Musiktools nicht die, die versprechen, Produzenten zu ersetzen.

Es sind die, die die Reibung bei den Teilen des Prozesses abbauen, die wir heimlich hassen – und dort aufhören, wo das kreative Urteil beginnt.

So sieht das in einem modernen Workflow aus.

Was kreative Erschöpfung Produzenten im DAW wirklich kostet

Jeder Produzent kennt den Unterschied zwischen guter und schlechter Müdigkeit.

Gute Müdigkeit: nach drei Stunden Snare-Feintuning die Session verlassen, weil der Groove endlich sitzt.

Schlechte Müdigkeit: merken, dass man dieselben drei Stunden mit dem Aufräumen einer Stimme verbracht hat, die hätte neu aufgenommen werden sollen – oder mit der Fehlersuche bei einem Phasenproblem auf einer Referenz-Spur, die man nur für 16 Takte brauchte.

2026 haben Produzenten mehr Tools als je zuvor.

Umfragen großer Plattformen zeigen: Während eine große Mehrheit der Künstler inzwischen irgendeine Form von KI im Prozess nutzt, beenden die meisten ungefähr gleich viele Tracks pro Jahr wie zuvor. Der Flaschenhals hat sich nicht verlagert – er ist nur offensichtlicher geworden.

Sprecht man mit arbeitenden Produzenten, hört man dieselben Schmerzpunkte:

-

Endlose Sound-Auswahl und Preset-Durchscrollen.

-

Dieselben grundlegenden Drum-Patterns und Akkordfolgen immer wieder von Grund auf bauen.

-

Technische Kleinarbeit – Stems trennen, Rauschreduktion, Loudness-Angleichung – die die begrenzte Studio-Zeit auffrisst.

Das Ergebnis ist eine spezifische Art kreativer Erschöpfung.

Man brennt nicht aus, weil man zu viele wichtige Entscheidungen trifft. Man brennt aus, weil man zu viele Entscheidungen trifft, die es nicht sind.

Hier kann KI tatsächlich helfen – wenn man die richtigen Tools für die richtigen Jobs einsetzt.

KI-Musikproduktions-Tools 2026 – Utility vs. Sketchpads

Wenn Produzenten 2026 von „KI-Musiktools“ sprechen, meinen sie meist zwei sehr unterschiedliche Software-Kategorien.

Sie auseinanderzuhalten ist der erste Schritt, um zu entscheiden, was in deinen Workflow gehört.

Utility-KI-Tools – die technische Arbeit komprimieren

Utility-Tools sind KI-gestützte Versionen von Aufgaben, die du ohnehin von Hand gemacht hast – nur langsamer und mit mehr Fluchen.

Typische Beispiele:

-

KI-Stem-Trennung, die Gesang, Drums, Bass und andere Instrumente aus einer Stereo-Datei zieht – mit weit weniger Artefakten als die alten EQ- und Phasen-Inversions-Tricks.

-

KI-Mastering-Assistenten, die einen schnellen, konsistenten Ausgangspunkt für Lautstärke und Klangbalance liefern, damit deine Referenz-Playlist nicht mehr bei jedem Track-Wechsel 6 dB springt.

-

KI-MIDI-Tools, die Akkordfolgen, Bassläufe und rhythmische Ideen vorschlagen, basierend auf dem, was du schon skizziert hast – und dir den „leeren Piano-Roll“-Starrkampf ersparen.

Zum Beispiel erlauben professionelle Stem-Trenn-Tools wie Get Stems, einen fertigen Song in bis zu sechs getrennte Instrument-Spuren zu splitten – Gesang, Drums, Bass und mehr – für Remixe und detaillierte Produktionsarbeit. Einen vollständigen Vergleich von KI-Stem-Splittern, Extendern und Vocal-Entfernung 2026 findest du in unserem Guide zu den besten KI-Stem-Splittern und Extendern.

Gut genutzt, sparen Utility-Tools Minuten oder Stunden bei Jobs, die nicht wirklich Geschmack erfordern.

Sie räumen die Straße frei, entscheiden aber nicht, wohin du fährst.

KI-Musik-Sketchpad-Tools – Ideen generieren, keine fertigen Songs

Die zweite große Kategorie sind KI-Musik-Sketchpad-Tools.

Statt einen fertigen, radio-tauglichen Track zu versprechen, erzeugen sie kurze, strukturierte musikalische Ideen – Loops, Sections, Stems und MIDI – die du in deine DAW ziehen und zu deinem eigenen Sound umformen kannst.

Vielleicht nutzt du schon Akkord-Plugins wie Scaler oder Cthulhu, um harmonisch aus dem Gröbsten zu kommen. KI-Sketchpads sind der nächste Schritt.

Statt eine einzelne Progression vorzuschlagen, liefern sie Multi-Track-Momente – Drums, Bass, Akkorde und Lead-Elemente im Zusammenspiel – sodass du auf Musik reagierst, nicht nur auf Theorie im Grid.

MusicMakerApp ist ein Beispiel für diesen Sketchpad-Ansatz: ein browserbasierter KI-Musikmacher, der lizenzfreie Stems und MIDI erzeugt, die du in deiner DAW arrangieren und neu vertonen kannst – statt dich in ein One-Click-„KI-Song“-Preset zu zwängen.

Der Unterschied ist entscheidend.

Voll-Song-Generatoren komprimieren oft den falschen Teil des Workflows. Sie hetzen dich durch Struktur und Sounddesign – die spaßigen, kreativen Teile – und lassen dich mit einem emotional flachen, klanglich festgefahrenen Track zurück.

Sketchpads drehen die Gleichung um.

Sie komprimieren das Setup – das leere Grid, die ersten acht Takte – und treten dann beiseite, damit du die Arbeit machen kannst, die einen Track wirklich zu deinem macht.

Die Workflow-Brücke – von KI-Generierung zu echter Musikproduktion

Das Interessanteste an 2026-Sessions ist für mich nicht, dass Produzenten „KI Songs machen lassen“.

Sondern dass sie KI nutzen, um die härteste Lücke im Prozess zu überbrücken: von vager Idee zu etwas, das du wirklich arrangieren, bearbeiten und mischen kannst.

Ein moderner KI-gestützter Musik-Workflow 2026 sieht nicht aus wie ein Klick und ein Master-Export.

Er sieht eher aus wie ein Staffellauf zwischen KI-Tools und DAW.

Ein typischer KI-Musikproduktions-Workflow 2026

Ein realistischer KI-gestützter Workflow 2026 sieht oft so aus:

-

Musikalische Richtung in einem KI-Musik-Sketchpad setzen Stimmung, Tempo und Stil wählen, dann ein paar kurze Sections oder Loops generieren. Vielleicht fragst du nach einem „warmen 120-BPM-Nacht-Groove mit weichen Keys und subbassigem Bass“ und hörst dir drei oder vier verschiedene Takes zu diesem Brief an.

-

Stems und MIDI exportieren Einzelne Drums, Bass, Akkorde und melodische Parts als WAV bouncen, plus MIDI-Dateien für den musikalischen Inhalt, den du neu vertonen willst. Saubere 24-Bit-WAV-Stems und Standard-MIDI lassen sich in jede moderne DAW integrieren.

-

Alles in deine DAW importieren Stems und MIDI in Ableton, FL Studio, Logic Pro oder was du nutzt ziehen. Jeden Part durch deine eigenen Synths, Sampler und Plugin-Ketten routen. Ab hier sieht es nicht mehr nach „KI-Output“, sondern nach jeder anderen Session aus.

-

Muten, umschreiben, humanisieren Rücksichtslos entfernen, was du nicht brauchst, Schlüsselzeilen umschreiben, Performance, Automation und Textur hinzufügen, damit der Track nach dir klingt. Automationskurven, Mikro-Timing und Sound-Auswahl sind, wo deine Persönlichkeit durchkommt.

-

Mit deiner üblichen Mix- und Master-Kette fertigstellen KI-generierte Parts wie Stems von einem Kollaborateur oder einem Sample-Pack behandeln: nützliche Ausgangspunkte, keine Gebote. Alle Balance-, EQ-, Kompressions- und Sättigungsentscheidungen triffst weiterhin du.

Tools wie MusicMakerApps Creation Lab bieten genau das als strukturierte KI-Musik-Erstellungsflüsse – Schritt-für-Schritt-Vorlagen, die Prompts, Generierung und Export zu einem Workflow verbinden, auf den du Session für Session bauen kannst.

Lizenz und Rechte im Blick behalten

Ein sehr unmusikalischer Punkt wird im Moment der Veröffentlichung musikalisch: Rechte.

2026 liegen bei fast jeder seriösen Plattform die vollen kommerziellen Rechte an KI-generierten Stems und MIDI hinter Bezahl-Tiers, nicht Free-Plänen.

Behandle KI-Output wie Sample-Packs: einmal die Lizenz lesen, bevor du releasest. Zu Kosten, Eigentum und einer Compliance-Checkliste für KI-generierte Alben siehe unseren KI-Album-Lizenz-Guide 2026.

Plattformen für den professionellen Einsatz wie MusicMakerApp formulieren ihren KI-Output ausdrücklich als urheberrechtssichere, lizenzfreie Bausteine für kommerzielle Projekte – damit du dich auf die Musik konzentrieren kannst statt auf spätere Clearance-Mails.

Warum KI in der Musikproduktion dich noch braucht

2026 fragen viele Schlagzeilen noch, ob KI Produzenten ersetzen wird.

Aus dem Blickwinkel echter Sessions ist die Antwort einfacher und weniger dramatisch: KI ersetzt die Teile der Produktion, die von Anfang an keinen Produzenten brauchten.

Sie ist sehr gut darin,

-

technische Probleme zu bereinigen,

-

plausible harmonische und rhythmische Muster zu erzeugen,

-

Lücken zu füllen, wenn du zu müde bist, noch eine Hi-Hat-Variation zu programmieren.

Sie ist deutlich schlechter darin,

-

zu erkennen, wann eine „richtige“ Akkordfolge emotional falsch ist für die Geschichte, die du erzählen willst,

-

zu entscheiden, dass der Refrain acht Takte später kommen sollte, damit der Hörer Zeit zum Atmen hat,

-

zu hören, dass eine leicht aus dem Takt geratene Bassnote der menschlichste Moment im ganzen Track ist.

Während KI die technische Lücke zwischen Einsteigern und Profis einebnet, bleibt der einzige dauerhafte Vorteil das kreative Urteil – nicht, wem die meisten Plugins gehören, sondern wer hören kann, wann eine Akkordfolge technisch richtig, aber emotional falsch ist.

2026 sind die Produzenten, die dauerhafte Karrieren aufbauen, nicht die, die KI die ganze Show leiten lassen.

Es sind die, die KI nutzen, um die langweiligen Teile zu komprimieren, und sich dann auf den eigenen Geschmack verlassen, um zu entscheiden, was bleibt, was geht und wann der Track endlich das sagt, was er sagen muss.

FAQ – KI-Musikproduktions-Tools und Workflows 2026

1. Was sind die Haupttypen von KI-Musikproduktions-Tools 2026?

Grob zwei Kategorien: Utility-Tools (KI-Stem-Trennung, KI-Mastering, KI-MIDI-Assistenten), die technische Aufgaben beschleunigen, und KI-Musik-Sketchpad-Tools, die Loops, Sections, Stems und MIDI erzeugen, die du in deiner DAW arrangieren kannst.

2. Wie nutzen Produzenten KI-Sketchpads, ohne generisch zu klingen?

Sie nutzen KI für die ersten 8–16 Takte – von der leeren Session zur brauchbaren Idee – und muten, ersetzen und schreiben dann Parts um. Die finale Arrangement-, Sounddesign- und Mix-Entscheidungen kommen weiterhin von ihren Ohren, nicht von einem Preset.

3. Zählt KI-generierte Musik 2026 wirklich für Hörer?

Ja, aber vor allem als Teil eines größeren Ökosystems. Umfragen großer Anbieter zeigen, dass ein nennenswerter Anteil der 18–44-Jährigen wöchentlich mehrere Stunden KI-generierte Musik hört – dennoch machen KI-Tracks unter 1 % der Gesamt-Streams aus. Entdeckung und Promotion bleiben überwiegend menschengetrieben.